Los medios llevan algún tiempo utilizando la inteligencia artificial y tecnologías similares, aunque en gran medida “detrás de escena”. Recientes desarrollos en los modelos de lenguaje de gran tamaño (LLM) y el lanzamiento público de ChatGPT a fines de 2022, seguidos de una avalancha de otras herramientas de IA generativa, marcaron un giro real en el interés del público y en la forma en que los editores analizan la implementación para la producción de contenidos.

Las investigaciones académicas sobre la adopción de la IA en las redacciones crece con rapidez (por ejemplo: Beckett y Yaseen, 2023; Simon, 2024), pero sabemos considerablemente menos sobre cómo las audiencias reciben estas innovaciones, sobre todo en un contexto global de baja o decreciente confianza en las noticias. Este año incluimos preguntas al respecto, en tiempos en los que el público mismo está aprendiendo sobre la IA en general y va formando sus opiniones, y pocos entenderán cómo estas tecnologías pueden emplearse en el periodismo específicamente.

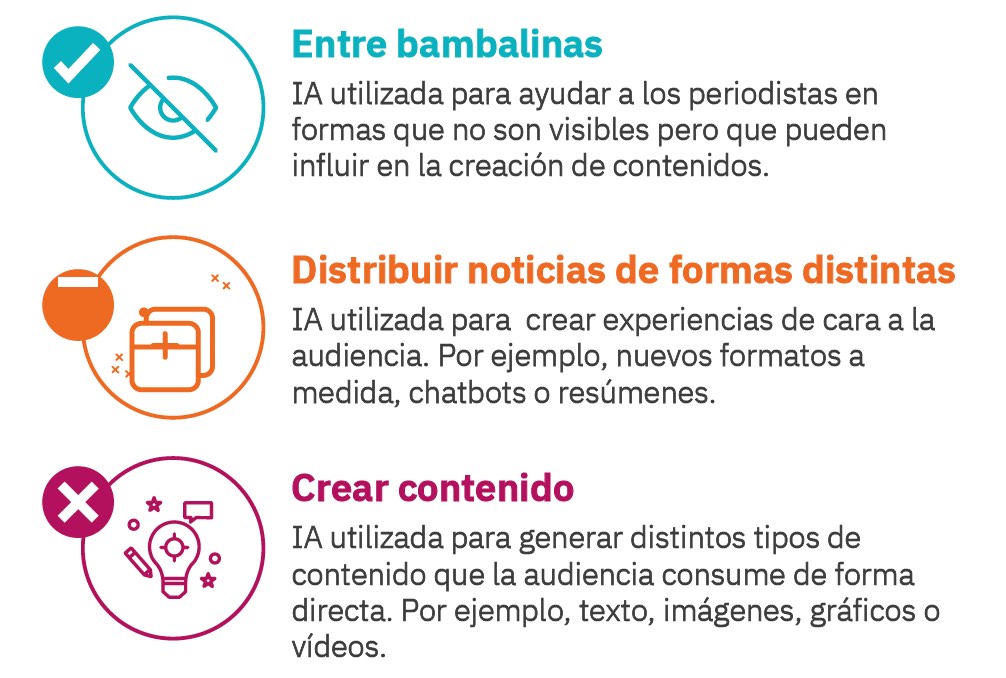

En el análisis que sigue, complementamos los datos de nuestra encuesta con citas ilustrativas y las claves de una investigación cualitativa que realizó la agencia Craft, con 45 usuarios de noticias digitales en México, el Reino Unido y Estados Unidos. En las entrevistas iniciales, los participantes hicieron una especie de "viaje deliberativo" individual, y se observó su comprensión básica sobre la IA y su nivel de comodidad; luego se les presentaron casos de uso de la IA en las noticias, para que experimenten y reflexionen. Así como los medios pueden recurrir a la IA para varias tareas, las audiencias abordan diferentes usos con distintos grados de comodidad: en líneas generales, les parece mejor para las tareas de backend y para innovar en la distribución de noticias, pero no tanto para generar contenidos.

Conocimiento sobre IA, y cómo influye en la visión sobre su uso en el periodismo

Antes de preguntar sobre el uso de la IA en las noticias, quisimos tener una idea del conocimiento de los encuestados sobre estas tecnologías en general. Resulta relativamente bajo en 28 mercados analizados: menos de la mitad (45%) dice haber escuchado o leído mucho o moderadamente al respecto. Mientras tanto, el 40% lo hizo poco y el 9%, nada en absoluto.

Más allá de las diferencias a nivel de países, el conocimiento de la IA varía de acuerdo con los grupos sociodemográficos, y se registran marcadas brechas según la edad, el género y la educación. En promedio, conocen más los jóvenes, los hombres y quienes tienen alto nivel educativo.

Estas cifras nos aportan una idea de cuánta información sobre la IA han visto los encuestados, pero no dónde, qué tipo de datos o qué experiencias han tenido con estas tecnologías. Estudios recientes señalan que la gente no siempre reconoce qué es la IA y la mayoría no la usa con regularidad.1 Nuestra investigación cualitativa se hace eco de estos hallazgos, y también muestra que, si bien es posible que un pequeño subconjunto ya esté usando herramientas de IA y seguramente vio información al respecto en las noticias y en las redes sociales, otros moldean sus percepciones a partir de series y películas de ciencia ficción.

La IA está en todos los dispositivos que utilizamos ahora: teléfonos, computadoras… en todo lo que hacemos en internet. Y hay cosas más avanzadas como ChatGPT, que los estudiantes ahora usan mucho.Mujer, 26 años, de México

Me preocupa un poco: si nos volvemos muy dependientes de la IA y la IA se convierte en algo grande… cómo la IA básicamente puede destruir el mundo. Es una visión muy “del espacio exterior”, pero no podemos evitar pensar en ello. Adoro la ciencia ficción, Terminator, Odisea del espacio…Hombre, 19 años, del Reino Unido

Comprender cuánto ha visto u oído la gente sobre la IA es importante para los medios porque, en ausencia de una experiencia personal, las representaciones populares desempeñan un papel enorme a la hora de influir en las percepciones sobre la IA en general, lo que a su vez incide en las actitudes hacia las noticias creadas con o por IA (algo que la mayoría probablemente no haya visto mucho aún). Según nuestros datos, actualmente sólo una minoría se siente cómoda consumiendo noticias creadas por humanos con la ayuda de IA (36%), y una proporción aún menor se siente cómoda consumiendo noticias creadas principalmente por IA con supervisión humana (19%).

También detectamos que la gente que sabe más sobre la IA tiende a sentirse relativamente más cómoda con su aplicación en el periodismo: si bien todavía es una cifra muy baja, es dos veces mayor (26%) con respecto a quienes han visto y oído menos sobre estas tecnologías (13%). Notamos una brecha similar en torno a las noticias producidas principalmente por un periodista con ayuda de la IA (45% y 30%, respectivamente).

Niveles de comodidad diferentes para diferentes usos de la IA

La mayoría de las audiencias han pensado poco y nada sobre cómo se puede utilizar la IA en el periodismo, y de nuestra investigación cualitativa surge que el punto de partida es generalmente de resistencia, sospecha y miedo. Sin embargo, al probar algunos casos de uso, los participantes a menudo desarrollan y explican opiniones más matizadas sobre qué les produce más y menos comodidad, dependiendo de si se utiliza detrás de escena, para distribuir noticias de nuevas formas o para generar contenido completamente nuevo. Las percepciones en torno a la IA evolucionan velozmente, y si bien en principio la mayoría siente cierto rechazo por la información producida con IA, es posible que, a medida que se familiaricen con estas tecnologías, habrá quienes se vuelvan más abiertos a su adopción, al menos para algunas funciones.

Si me dijeran que esto fue producido por una IA, probablemente diría: “Está bien, entonces no lo leeré”.Hombre, 40 años, del Reino Unido

Durante años, muchos medios han utilizado inteligencia artificial y tecnologías similares para tareas detrás de escena, como monitorear los temas del momento en el mundo online, transcribir entrevistas y personalizar recomendaciones para los lectores (Beckett, 2019). No obstante, las preocupaciones con respecto a los límites y a las mejores prácticas han ganado relevancia a medida que más redacciones exploran el uso de la IA generativa para aplicaciones cada vez más públicas. En Estados Unidos, por ejemplo, Men’s Journal ha recurrido a estas tecnologías para hacer resúmenes basados en artículos publicados. En México y el Reino Unido, radios y canales de televisión han experimentado con presentadores de noticias sintéticos. Otros han probado aplicaciones para testear titulares, viñetas de síntesis, chatbots, creación de imágenes y traducción de notas. De todos modos, la mayoría de los medios se mueven con cautela, aprendiendo de los contratiempos de otros que han sido objeto de escrutinio por no informar lo suficiente y por falta de supervisión, lo que ha resultado en publicaciones inexactas en sus sitios web.2

Nuestra investigación cualitativa expone que la gente tiende a sentirse más cómoda con la aplicación de la IA detrás de escena, donde los periodistas la utilizan para hacer su trabajo más eficiente y de maneras que no son directamente visibles para el público. Y se siente menos cómoda (pero en algunos casos, abierta) si la IA interviene para distribuir noticias en nuevos modos y formatos, especialmente cuando mejora las experiencias de usuarios y aumenta la accesibilidad. Y lo que provoca más incomodidad es el uso de la IA para generar contenido completamente nuevo. Más allá de cada caso, existe un consenso generalizado en torno a que la automatización total debería estar fuera de consideración, y que un ser humano siempre debería estar “encima”: esto coincide con la visión de la mayoría de los editores cuando analizan cómo implementar la IA generativa.

Comodidad del público con el uso de la IA en las diferentes etapas de la producción de noticias

Me siento algo/mayormente cómoda con la IA manipulando y reformateando la información hasta cierto punto, pero la IA no parece estar creando contenido nuevo en estos escenarios.Mujer, 24 años, de Estados Unidos

Si bien el público tiende a sentirse incómodo cuando la IA crea contenido, no todas las formas se consideran del mismo modo. Los participantes muestran menos resistencia cuando la IA genera contenido basado en texto, seguido de ilustraciones o gráficos y animaciones, que para muchos no representan nada nuevo y añaden atractivo estético. La mayoría se opone firmemente al uso de la IA para crear fotografías y especialmente videos de aspecto realista, incluso si se incluye una advertencia al respecto. Investigaciones anteriores indican que la gente a menudo se apoya en imágenes y videos como “atajos mentales” cuando intenta discernir en qué confiar online, y muchos expresan la idea “ver para creer” (por ejemplo: Ross Arguedas y otros, 2023). Esta función crucial de las imágenes, que suelen servir como prueba de lo que se informa, ayuda a explicar por qué provocan mayor inquietud las creaciones sintéticas que alteran esa lógica.

Algunos usos de la IA no modifican nada; son gráficos, imágenes complementarias, y pueden hacer más atractivo el contenido.Mujer, 24 años, de México

Para producir imágenes y cosas así, es un poco más complicado porque puede generar imágenes que parecen mostrar algo que no es la realidad, especialmente cuando el autor aporta los prompts.Hombre, 41 años, de Estados Unidos

Ejemplos de los formatos mostramos a los participantes de nuestra investigación

Como señala el resumen ejecutivo de este Digital News Report 2024, la comodidad también depende del tema. Si bien los niveles son bajos en general, las audiencias expresan más incomodidad cuando la IA se utiliza para generar contenido sobre asuntos relevantes, como la política, que si se emplea en otros menos significativos, como los deportes. Los participantes en nuestra investigación cualitativa subrayan que el potencial de causar daño y su alcance varían considerablemente según el asunto.

Los diferentes tipos de noticias tienen pesos diferentes. La IA verificando resultados de partidos de fútbol para un artículo casi no tiene consecuencias si informa algo erróneo o sesgado. Pero si se trata de un artículo sobre un partido político o noticias electorales, puede tener consecuencias catastróficas.Persona no binaria, 24 años, de Estados Unidos

El tipo de información que se produce también influye en las percepciones: algunas personas están más abiertas al uso de la IA generativa para contenidos basados en "hechos" y "números" verificables, como resultados deportivos o incluso informes electorales, pero no tanto cuando se trata de noticias más complejas, donde creen necesaria la interpretación humana, la ponderación de los matices, la sensibilidad y hasta la emoción. Tales distinciones no tienen que ver sólo con la precisión, sino también con cuestiones más filosóficas en torno a qué es el periodismo y qué clase de trabajos la gente piensa que son fundamentalmente humanos, y así deberían seguir.

Lo mejor es tratar de limitar el uso de la IA a los hechos, números, estadísticas, y no al análisis o la opinión, donde es necesario dar más contexto. Ahí es donde se necesitan los humanos: para aportar ese valor.Mujer, 52 años, de MéxicoCuando las noticias son potentes y desesperanzadoras, provocan algo muy conmovedor. Lo quieras o no, te afectará de una forma u otra, y siento que los humanos tienen ese contexto emocional.Hombre, 19 años, del Reino Unido

Las noticias con IA, el aviso y la confianza

Una inquietud clave de los medios que experimentan con la IA es cómo el uso de estas tecnologías puede afectar la confianza en las noticias, que ha disminuido en muchos países en los últimos años, tal como lo demuestran los datos de nuestro Digital News Report. A muchos les preocupa la posibilidad de que se genere información sesgada, inexacta o falsa. Sin embargo, más allá de garantizar la calidad del producto periodístico, algunos lidian con las mejores prácticas para avisar al público cuando se emplea la IA. Por un lado, brindar transparencia puede ayudar a manejar las expectativas y mostrar buena fe. Por el otro, el simple hecho de saber que los medios usan IA puede disminuir la confianza de las audiencias que a su vez desconfían de estas tecnologías. Las primeras investigaciones experimentales marcan que la gente considera menos confiables a aquellas noticias que tienen la etiqueta “generadas por IA”, en comparación con las creadas por humanos.3 Esta tensión significa que las organizaciones periodísticas deben pensar detenidamente cuándo es necesario avisar y cómo comunicarlo.

Es muy importante la supervisión humana. Confío más en un humano, porque tenemos la capacidad de analizar y discernir, mientras que la IA no es sensible, tiene errores, no sabe decidir qué hacer… no tiene una brújula moral.Hombre, 28 años, de México

Cuando se les pregunta sobre la etiqueta en general, los participantes de nuestra investigación le dan la bienvenida y a menudo exigen total transparencia sobre el uso de la IA en el periodismo. Sin embargo, al indagar sobre diversas aplicaciones de la IA, no todos consideran que el aviso sea necesario en cada caso. Algunos creen que es menos importante cuando se trata de usos detrás de escena y ayuda al periodista a acelerar su trabajo. Pero la etiqueta resulta imperativa cuando es un producto de cara al público, especialmente aquellos hechos principalmente por la IA, ya que podría determinar cómo abordan esa información o directamente si quieren consumirla.

No creo necesario avisar cuando se usa detrás de escena y hay un humano interactuando... Todavía se trata de algo basado en humanos, y sólo colabora con herramientas de asistencia, así que creo que está bien y acelera mucho el proceso.Hombre, 26 años, del Reino Unido

Los medios y los periodistas siempre deben informar a los consumidores sobre el uso de la IA. Pienso que hay beneficios concretos teniendo ese tipo de transparencia... así los usuarios pueden decidir por sí mismos si quieren consumir ese contenido o no.Mujer, 28 años, de Estados Unidos

La confianza puede determinar en sí misma cuán cómoda se siente la gente al consumir noticias producidas por (o con ayuda de) la IA. Detectamos que las audiencias que confían en las noticias tienden a sentirse más cómodas, en particular cuando se trata de contenidos producidos principalmente por humanos con la asistencia de la IA. Las brechas en los niveles de comodidad entre quienes confían y quienes no confían van desde 24 puntos porcentuales en Estados Unidos hasta 10 puntos en México. Es probable que la gente que tiende a confiar en las noticias en general tenga mayor fe en la capacidad de los medios para utilizar la IA de modo responsable, en comparación con quienes desconfían.

También observamos evidencia de esto en nuestros hallazgos cualitativos, tanto en general como a nivel de marcas. La gente que confía en medios determinados (sobre todo, aquellos a los que describen como respetables y prestigiosos) también tiende a estar más abierta al uso de la IA por parte de esas organizaciones. Ya sea porque consideran a estos medios más benévolos, porque tienen más fe en sus capacidades de supervisión o simplemente piensan que tienen más que perder si lo hacen descuidadamente, estos segmentos del público parecen menos incómodos con el uso de la IA a cargo de los periodistas. Por otro lado, las audiencias que ya son escépticas o cínicas con respecto a los medios pueden ver aún más erosionada su confianza debido a la implementación de estas tecnologías.

Depende de quién la use… Si es un medio serio, reconocido y prestigioso, siento que será bien utilizada, porque no creo que una empresa ponga en juego su prestigio.Hombre, 28 años, de México

Conclusión

Así como no existe una única tecnología o aplicación de la IA, tampoco existe una opinión única del público sobre si es aceptable o no su empleo en el periodismo. Si bien el punto de partida es en gran medida de resistencia, al examinar usos específicos la gente expresa opiniones con matices, y nuestros hallazgos resaltan qué áreas parecen generar más comodidad y cuáles probablemente presenten ciertos peligros, de modo que los medios deberían directamente evitarlas o actuar con cuidado.

La investigación que llevamos a cabo muestra que las audiencias están más abiertas a los usos de la IA que ocurren detrás de escena y en tareas donde ayuda a mejorar sus experiencias, aportando información más accesible y personalizada. Hay menos comodidad cuando se trata de contenido dirigido al público, temas sensibles o importantes, e imágenes y videos sintéticos que pueden parecer reales y donde las consecuencias del error se consideran más relevantes. En general, el consenso es que un ser humano siempre debe estar al tanto y que debe evitarse la automatización completa.

Enhebrar cuidadosamente la aguja a la hora de avisar cuando se usa la IA será crucial para los medios preocupados por la confianza de las audiencias, al igual que explicar cómo se emplean estas tecnologías en el periodismo. Un etiquetado excesivo o vago puede alejar a quienes ya tienen poca confianza y/o a quienes poseen conocimientos limitados sobre lo que implican estos usos; probablemente asumirán conjeturas negativas. Pero no proporcionar datos que tal vez la gente desea para decidir qué noticias consumir y en cuáles confiar puede resultar igualmente perjudicial.

Todavía estamos en una etapa temprana, y las actitudes del público hacia la aplicación de la IA en el periodismo seguirán evolucionando, sobre todo a medida que vaya cambiando el equilibrio entre las consideraciones abstractas y las experiencias prácticas si una mayor parte de las audiencias utilizan más las herramientas de IA en sus vidas personales y profesionales. Hoy, mucha gente tiene claro que ciertas áreas deberían permanecer bajo control humano. En este tipo de tareas (que requieren emoción, juicio y conexión de índole humana) es donde los medios deberían mantener a los seres humanos en primer plano.

Notas al pie

1Ver ONS y Pew Research Center.

3 https://ora.ox.ac.uk/objects/uuid:5f3db236-dd1c-4822-aa02-ce2d03fc61f7/files/s9306t097c